Online games als Call of Duty hebben meestal voice chat, maar trouwe fans weten natuurlijk dat je daardoor af en toe ook onaangename dingen te horen krijgt. Maar met Call of Duty Modern Warfare 3 is dat een stuk minder. Dat vertelt Activision in een nieuwe blogpost.

Het afgelopen jaar heeft Activision veel stappen gezet om de toxic sfeer die er soms is in de online multiplayer van Call of Duty wat draaglijker te maken. Dat lijkt aardig goed te lukken, mede dankzij nieuwe systemen om automatisch te kunnen modereren. Met name een AI-programma dat naar voice chat luistert om toxic gedrag op te speuren is erg effectief.

Met dit programma, dat een paar maanden voor de release van Modern Warfare 3 werd uitgebracht, is het aantal spelers dat te maken krijgt met storende uitspraken in voice chat flink verminderd. Activision spreekt van een vermindering van 50 procent, dus een halvering, sinds de lancering van Modern Warfare 3. Ook is het aantal spelers dat herhaaldelijk de gedragscode breekt met 8 procent gedaald.

Hoewel automatische moderatie dus effectief is, vraagt Activision nog steeds dat spelers meldingen maken van toxic gedrag. Dat gebeurde aanvankelijk nog maar weinig. Om het aan te moedigen krijgen spelers die een melding maken nu een bedankje voor de melding. In de toekomst hoopt Activision het ook aan spelers te kunnen melden als hun rapporten tot actie texen een toxic speler hebben geleid.

Gedragscode Call of Duty krijgt update

Om duidelijk te zijn over wat Call of Duty wel en niet tolereert in de online-modus is de gedragscode van de game geüpdatet. Hij maakt nu duidelijk dat elke vorm van pesterijen op basis van onder andere ras, identiteit, seksualiteit of geloof niet geoorloofd is. Er mag geen kwetsende taal of hate speech in text of voice chat voorkomen.

Populair Nieuws

De MSI Claw is de ideale handheld voor op vakantie

Van deze games zijn er LEGO-sets

Column: Xbox schiet zichzelf in de voet met multiplatform-strategie

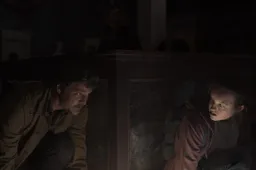

Zo zien Joel en Ellie eruit in The Last of Us seizoen 2

Nieuwe Mario-game nu al voor een spotprijs te scoren

Pokémon is op de Switch succesvoller dan ooit

Laatste Reacties

- Bella is niet veel veranderd qua uiterlijk,. Als je naar de game kijkt zit daar wel een mooi verschil in. Bella blijft er jong uit zien, maar wel een goede actrice en vertolkt Ellie goed.

Spiral16-05-2024

Spiral16-05-2024 - Tallneck heb ik thuis, nog geen tijd gehad om op te bouwen.

Spiral16-05-2024

Spiral16-05-2024 - Jammer maar het zorgt er alleen maar voor dat ik volgend jaar een Playstation koop en dan halo enz kan spelen.Johannesmulder16-05-2024

- Is het een beetje een goeie gimma?

Patrikov16-05-2024

Patrikov16-05-2024 - Zit al heel lang op een assassins creed game re wachten in het oude japan

Patrikov16-05-2024

Patrikov16-05-2024 - Ben benieuwd of ze er ook eentje van een Ewok hebben.Die zijn er echt voor gemaakt.

Warriorpriestess16-05-2024

Warriorpriestess16-05-2024 - Helemaal geen verkeerde game om te claimen!Pepko16-05-2024

- Kijk uit naar het 4e seizoen!Dutchman16-05-2024

- Ik ben juist erg benieuwd naar Cat Quest. Lijken me leuke games!JustB16-05-2024

- Een paar van de oude Mario spellen heb ik over het hoofd gezien.Wil ze wel een keertje uitspelen gewoon om te zien of ze nu ook wat voor mij weten doen.

Warriorpriestess16-05-2024

Warriorpriestess16-05-2024